Большие языковые модели, или LLM, — это основа современных AI-ассистентов.

Но одно из самых распространённых заблуждений на рынке звучит так:

«Просто выберите лучшую LLM — и всё будет работать».

На практике ни одна LLM не является лучшей во всём.

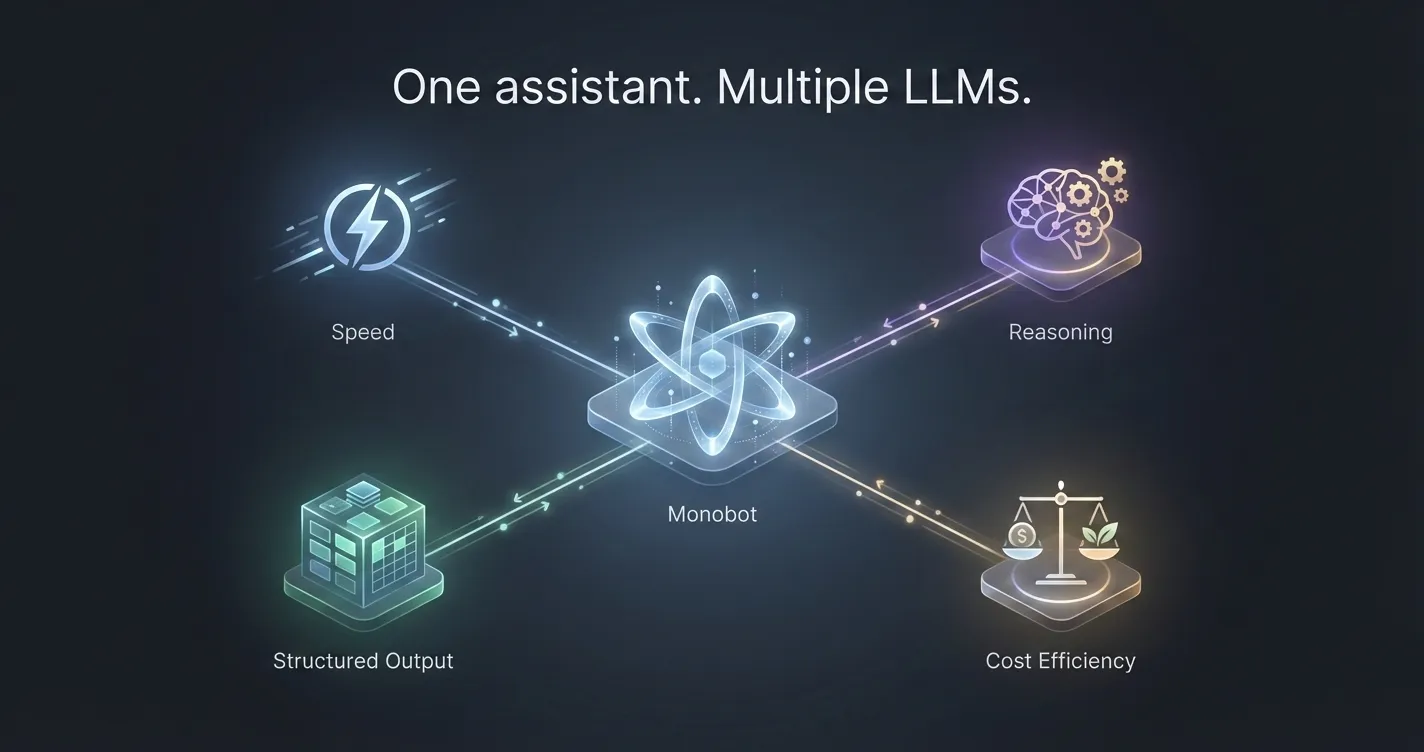

Разные задачи требуют разных сильных сторон:

скорости, глубины рассуждений, экономичности, многоязычной поддержки или структурированного вывода.

Именно поэтому Monobot разработан для работы с несколькими LLM, подбирая подходящую модель под каждую конкретную задачу, а не пытаясь пропустить всё через одну.

Одна модель ≠ одно решение

LLM заметно различаются по тому, как они работают:

- одни быстрее, но менее точны;

- одни глубже рассуждают, но работают медленнее;

- одни отлично подходят для диалога, другие — для структурированных данных;

- одни экономичны в масштабе, другие относятся к премиум-сегменту.

Использование одной модели для всех сценариев часто приводит к компромиссам:

- более высоким затратам;

- более медленным ответам;

- более низкой точности в критически важных сценариях.

В продуктивной среде эти компромиссы действительно важны.

Как Monobot использует несколько LLM

Monobot создан как platform-agnostic система, то есть:

- мы не привязаны к одному провайдеру;

- разные модели могут назначаться для разных задач;

- модели можно заменять или обновлять без переработки всей системы.

Эта гибкость позволяет Monobot адаптироваться по мере развития моделей — а они развиваются очень быстро.

Подбор модели под задачу

Вот как несколько LLM обычно используются внутри Monobot:

1. Разговорный поток и голосовые взаимодействия

Некоторые задачи требуют в первую очередь:

- низкой задержки;

- естественного диалога;

- стабильного разговорного тона.

Для таких сценариев Monobot может использовать модели, оптимизированные для взаимодействия в реальном времени, особенно в голосовых сценариях, где задержки разрушают пользовательский опыт.

2. Задачи с повышенными требованиями к рассуждению и принятию решений

Другие сценарии требуют:

- многошагового рассуждения;

- уточнения и распознавания намерений;

- проверки сложной логики.

В таких случаях Monobot может направлять запросы в более продвинутые reasoning-модели, обеспечивая приоритет точности над скоростью.

3. Структурированные ответы и бизнес-действия

Когда ассистенту нужно:

- извлекать структурированные данные;

- проверять вводимые данные;

- запускать рабочие процессы;

- вызывать API,

приоритетом становятся последовательность и надёжность, а не креативность.

Monobot назначает модели, которые лучше всего справляются с:

- выводом по схеме;

- детерминированными ответами;

- строгим форматированием.

4. Оптимизация затрат для большого объёма запросов

Не каждое взаимодействие требует модели топ-уровня.

Для:

- повторяющихся вопросов;

- простых подтверждений;

- обновлений статуса

Monobot может использовать более лёгкие и экономичные модели, что существенно снижает операционные расходы при масштабировании.

Почему это важно в реальной эксплуатации

Использование нескольких LLM — это не просто гибкость для разработчиков.

Это стабильность, производительность и контроль затрат для бизнеса.

Благодаря multi-model подходу Monobot может:

- снижать задержку там, где важна скорость;

- повышать точность там, где ошибки обходятся дорого;

- масштабироваться без резкого роста затрат;

- избегать зависимости от одного поставщика;

- быстро адаптироваться к появлению более сильных моделей.

Это особенно важно для голосовых ассистентов, клиентской поддержки и сценариев с высокой степенью автоматизации.

Архитектура, готовая к будущему

Ландшафт LLM меняется каждый месяц.

Появляются новые модели.

Существующие улучшаются или теряют качество.

Меняются цены.

Эволюционируют возможности.

Monobot спроектирован так, чтобы ассистент оставался стабильным даже тогда, когда сами модели меняются.

Бизнесу не нужно заново перестраивать свою логику каждый раз, когда AI-экосистема делает шаг вперёд — Monobot берёт эту сложность на себя.

Итог

Будущее AI-ассистентов — не в выборе одной «лучшей» LLM.

Оно в создании систем, которые умеют:

- использовать правильную модель для правильной задачи;

- развиваться без поломок;

- оставаться эффективными, точными и надёжными в продуктивной среде.

Именно поэтому Monobot использует несколько LLM — и именно поэтому этот подход гораздо важнее, чем многим кажется.